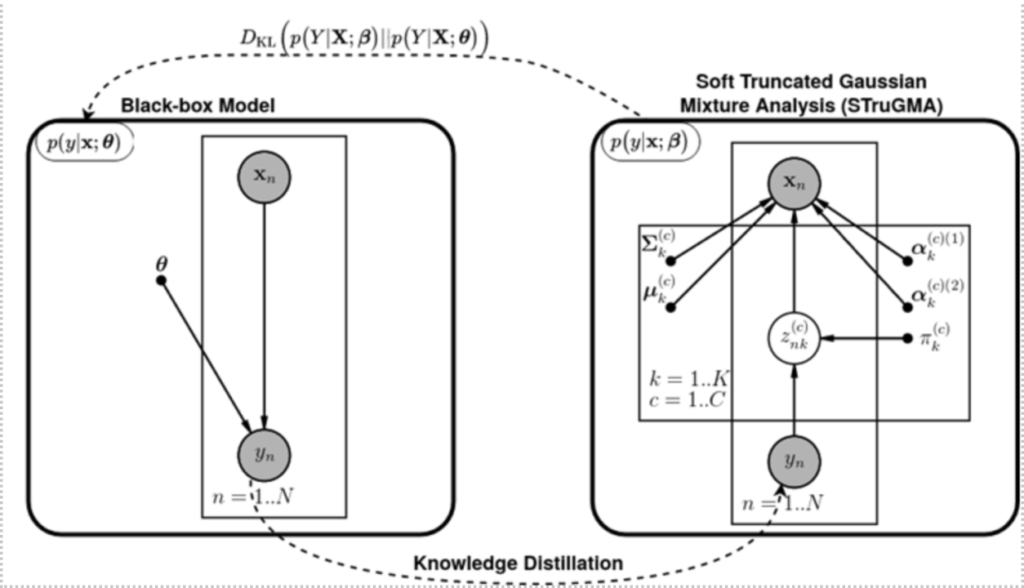

Géraldin Nanfack, chercheur à l’UNamur, travaille depuis décembre 2018 sur sa thèse dans le cadre du projet EOS VeriLearn. Ses travaux de recherche ont pour but de garantir le respect des propriétés ou de certaines contraintes à des algorithmes de Machine Learning. Par exemple, dans l’un de ses travaux [1] publiés à la conférence ESANN’21, il a proposé une méthode pour forcer des algorithmes d’arbres de décision à prendre des décisions équitables par rapport à descaractéristiques sensibles comme la race ou le genre. Dans un autre travail [2] publié à la conférence UAI’21, il a développé une méthode visant à contraindre des modèles dits “black-box” et différentiables comme des réseaux de neurones, à s’expliquer facilement et globalement par des règles de décisions afin que les utilisateurs non- experts de cette intelligence artificielle puissent comprendre comment les décisions ont été prises.

Ses travaux visent à avoir une Intelligence Artificielle (IA) plus fiable, qui pourra être dotée de facultés pour fournir des explications fidèles de son comportement. Cette évolution de l’IA est précieuse pour plusieurs secteurs sensibles comme celui de la santé ou bancaire qui pourrait utiliser une IA prédisposée à fournir des explications fiables de ses décisions tout en garantissant ou maximisant l’équité dans ses prédictions.

[1] Nanfack, G., Delchevalerie, V., & Frénay, B. (2021). Boundary-Based Fairness Constraints in Decision Trees and Random Forests. In The 29th European Symposium on Artificial Neural Networks, Computational Intelligence and Machine Learning, https://proceedings.mlr.press/v161/nanfack21a.html.

[2] Nanfack, G., Temple, P., & Frénay, B. (2021, December). Global explanations with decision rules: a co-learning approach. In Uncertainty in Artificial Intelligence (pp. 589-599). PMLR, https://pure.unamur.be/ws/portalfiles/portal/61249591/ES2021_69.pdf.